Yleiskatsaus lineaarisen regression mallinnuksesta

Kun alkaa oppia koneoppimisen algoritmeista, alkaa oppia ML-algoritmien eri tapoja, ts. Ohjattua, valvomatonta, puolivalvottua ja vahvistusoppimista. Tässä artikkelissa käsittelemme ohjattua oppimista ja yhtä perusteellisista, mutta tehokkaista algoritmeista: Lineaarinen regressio.

Siksi ohjattu oppiminen on oppimista, jossa koulutamme konetta ymmärtämään harjoitustietojoukossa annettujen tulo- ja lähtöarvojen välinen suhde ja käyttämään sitten samaa mallia ennustamaan testaustietojoukon lähtöarvot. Joten lähtökohtana on, että jos meillä on jo tulostetut tiedot tai merkinnät koulutustietojoukossamme ja olemme varmoja siitä, että annetulla tuotoksella on järkevä merkitys syötteelle, käytämme ohjattua oppimista. Ohjatut oppimisalgoritmit luokitellaan regressioon ja luokitukseen.

Regressioalgoritmeja käytetään, kun huomaat, että lähtö on jatkuva muuttuja, kun taas luokittelualgoritmeja käytetään, kun lähtö on jaettu osiin, kuten Hyväksy / Epäonnistuminen, Hyvä / Keskimääräinen / Huono jne. Meillä on erilaisia algoritmeja regression tai luokituksen suorittamiseen. toimenpiteet lineaarisen regression algoritmin ollessa regression perusalgoritmi.

Tultuaan tähän regressioon, ennen kuin pääsen algoritmiin, anna minun asettaa perusta sinulle. Toivon, että muistat koulussa käydessäsi viivayhtälökonseptia. Annan lyhyesti tämän. Sinulle annettiin kaksi pistettä XY-tasolla eli sanotaan (x1, y1) ja (x2, y2), missä y1 on x1: n lähtö ja y2 on x2: n lähtö, silloin pisteiden läpi kulkeva linjayhtälö on (y- y1) = m (x-x1) missä m on viivan kaltevuus. Nyt, kun olet löytänyt viivayhtälön, jos sinulle annetaan pisteen sanonta (x3, y3), pystyt helposti ennustamaan, onko piste linjalla vai pisteen etäisyys linjasta. Tämä oli perusregressio, jonka olin tehnyt koulussa, edes tajuamatta, että sillä olisi niin suuri merkitys koneoppimisessa. Mitä teemme tässä yleensä, yritä tunnistaa yhtälöviiva tai käyrä, joka sopisi oikein junadatajoukon tuloon ja lähtöön, ja sitten käyttää samaa yhtälöä ennustamaan testitietosarjan lähtöarvo. Tämä johtaisi jatkuvaan haluttuun arvoon.

Määritelmä Lineaarinen regressio

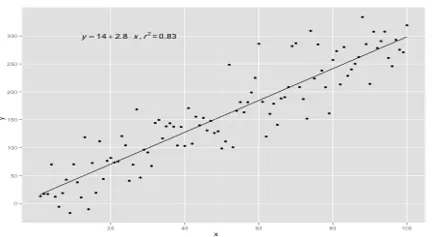

Lineaarinen regressio on ollut olemassa jo kauan (noin 200 vuotta). Se on lineaarinen malli, ts. Se olettaa lineaarisen suhteen tulomuuttujien (x) ja yhden lähtömuuttujan (y) välillä. Tässä y lasketaan tulomuuttujien lineaarisella yhdistelmällä.

Meillä on kahta tyyppiä lineaarista regressiota

Yksinkertainen lineaarinen regressio

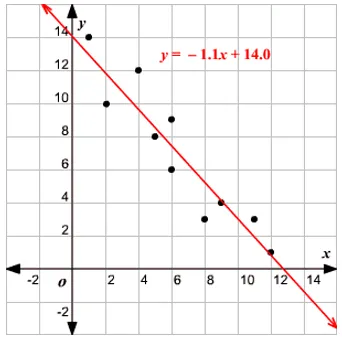

Kun on yksi syöttömuuttuja, ts. Viivayhtälö on c

katsotaan y = mx + c, niin se on yksinkertainen lineaarinen regressio.

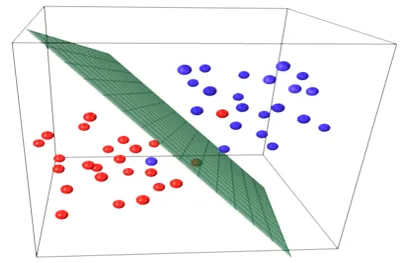

Useita lineaarisia regressioita

Kun sisääntulomuuttujia on useita, ts. Viivayhtälöä pidetään y = ax 1 + bx 2 +… nx n, niin se on useita lineaarisia regressioita. Regressioyhtälön valmistelemiseksi tai kouluttamiseksi tiedoista käytetään erilaisia tekniikoita, ja yleisintä niistä kutsutaan tavallisiksi vähimmäisruuduiksi. Mainitulla menetelmällä rakennettua mallia kutsutaan tavalliseksi pienimmän neliösumman lineaariseksi regressioon tai vain pienimmän neliösumman regressioon. Malliä käytetään, kun määritettävät tulo- ja lähtöarvot ovat numeerisia. Kun on vain yksi tulo ja yksi lähtö, silloin muodostunut yhtälö on viivayhtälö eli

y = B0x+B1

jossa juovan kertoimet määritetään tilastollisin menetelmin.

Yksinkertaiset lineaariset regressiomallit ovat erittäin harvinaisia ML: ssä, koska yleensä meillä on erilaisia syöttötekijöitä lopputuloksen määrittämiseksi. Kun sisääntuloarvoja on useita ja yksi lähtöarvo, muodostettu yhtälö on tason tai hypertason taso.

y = ax 1 +bx 2 +…nx n

Regressiomallin perusajatuksena on saada datalle parhaiten sopiva viivayhtälö. Paras istuvuusrivi on se, jossa kokonaisennustevirhe kaikille mahdollisimman pieniksi pidettäville datapisteille. Virhe on tason pisteen välinen etäisyys regressioviivaan.

esimerkki

Aloitetaan esimerkillä yksinkertaisesta lineaarisesta regressiosta.

Henkilön pituuden ja painon välinen suhde on suoraan verrannollinen. Vapaaehtoisilla on tehty tutkimus henkilön korkeuden ja ihannepainon määrittämiseksi ja arvot on tallennettu. Tätä pidetään harjoitustietoryhmässämme. Harjoitustietoa käyttämällä lasketaan regressioviivayhtälö, joka antaa minimivirheen. Tätä lineaarista yhtälöä käytetään sitten ennusteiden tekemiseen uusiin tietoihin. Toisin sanoen, jos annamme henkilön korkeuden, vastaava paino pitäisi ennustaa meidän kehittämämme malli pienin tai nolla virhe.

Y(pred) = b0 + b1*x

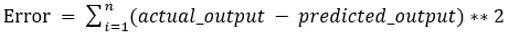

Arvot b0 ja b1 on valittava siten, että ne minimoivat virheen. Jos neliövirheen summaa pidetään mallina mallin arvioimiseksi, tavoitteena on saada rivi, joka pienentää virhettä parhaiten.

Puristamme virheen, jotta positiiviset ja negatiiviset arvot eivät poista toisiaan. Yhdellä ennusteella varustetulle mallille:

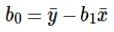

Leikkaus (b0) lasketaan linjayhtälössä:

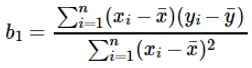

Tuloarvon x kerroin lasketaan seuraavasti:

Kerroimen b 1 ymmärtäminen:

- Jos b 1 > 0, niin x (tulo) ja y (lähtö) ovat suoraan verrannollisia. Eli x: n lisäys kasvaa y, kuten korkeus kasvaa, paino kasvaa.

- Jos b 1 <0, niin x (ennustaja) ja y (tavoite) ovat käänteisesti verrannollisia. Eli x: n lisäys vähenee y, kuten ajoneuvon nopeus kasvaa, ajan kuluminen vähenee.

Kerroin b 0 ymmärtäminen:

- B 0 ottaa mallin jäännösarvon ja varmistaa, että ennuste ei ole puolueellinen. Jos meillä ei ole B 0 -termiä, niin juovayhtälö (y = B 1 x) pakotetaan läpäisemään alkuperän kautta, ts. Malliin asetetut tulo- ja lähtöarvot johtavat arvoon 0. Mutta näin ei ole koskaan, jos meillä on 0 tulossa, sitten B 0 on kaikkien ennustettujen arvojen keskiarvo, kun x = 0. Kaikkien ennustaja-arvojen asettaminen arvoon 0 tapauksessa x = 0 johtaa tietojen menetykseen ja on usein mahdotonta.

Edellä mainittujen kertoimien lisäksi tämä malli voidaan laskea myös normaaleilla yhtälöillä. Aion keskustella tarkemmin normaalien yhtälöiden käytöstä ja yksinkertaisen / monilinjaisen regressiomallin suunnittelusta tulevassa artikkelissani.

Suositellut artikkelit

Tämä on opas lineaarisen regression mallintamiseen. Tässä keskustellaan määritelmästä, lineaarisen regression tyypeistä, joka sisältää yksinkertaisen ja moninkertaisen lineaarisen regression, sekä joitain esimerkkejä. Voit myös katsoa seuraavia artikkeleita saadaksesi lisätietoja -

- Lineaarinen regressio R: ssä

- Lineaarinen regressio Excelissä

- Ennustava mallintaminen

- Kuinka luoda GLM R: ssä?

- Lineaarisen regression ja logistisen regression vertailu