Johdatus pakkaamiseen ja lisäämiseen

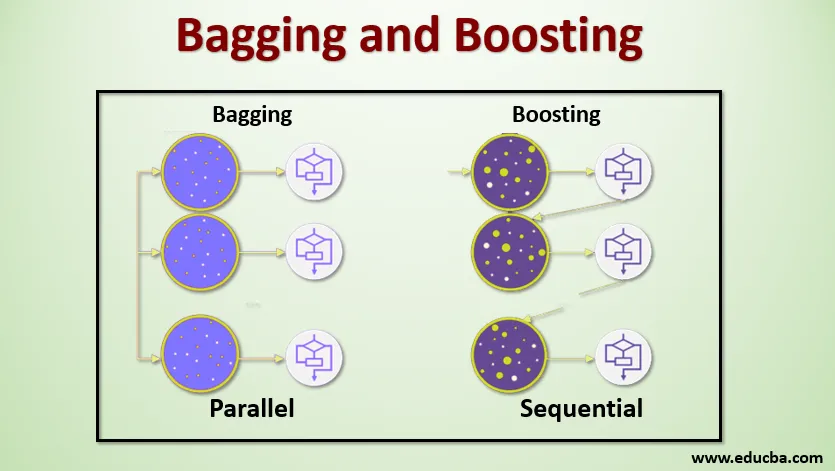

Bagging ja Boosting ovat kaksi suosittua ensemble menetelmä. Joten ennen kuin ymmärrämme pussittamista ja lisäämistä, saakaamme kuvan siitä, mikä on ryhmäoppiminen. Tekniikka on käyttää useita oppimisalgoritmeja kouluttamaan malleja, joilla on sama tietojoukko ennusteen saamiseksi koneoppimisessa. Saatuaan ennusteen jokaisesta mallista käytämme mallin keskiarvotekniikoita, kuten painotettu keskiarvo, varianssi tai enimmäisäänestys lopullisen ennusteen saamiseksi. Tämän menetelmän tavoitteena on saada parempia ennusteita kuin yksittäinen malli. Tämä johtaa parempaan tarkkuuteen, jotta vältetään ylimääräiset asennukset, ja vähentää esijännitystä ja ko-varianssia. Kaksi suosittua yhtyemenetelmää ovat:

- Pussitus (Bootstrap Aggregating)

- tehostaminen

säkitys:

Pakkaamista, joka tunnetaan myös nimellä Bootstrap Aggregating, käytetään tarkkuuden parantamiseen ja malli tehdään yleisemmäksi vähentämällä varianssia eli välttämällä ylimääräistä asennusta. Tässä otamme koulutuksen tietojoukon useita osajoukkoja. Jokaiselle osajoukolle otamme mallin, jolla on samat oppimisalgoritmit, kuten päätöksentekopuu, logistinen regressio jne., Ennustaaksesi tuloksen samalle testitietojoukolle. Kun meillä on ennuste jokaisesta mallista, käytämme mallin keskiarvotekniikkaa lopullisen ennustetuoton saamiseksi. Yksi kuuluisista Bagging-tekniikoista on Random Forest . Random-metsässä käytämme useita päätöspuita.

Tehostaminen :

Tehostamista käytetään ensisijaisesti ohjaaman oppimistekniikan vääristymisen ja variaation vähentämiseen. Se viittaa algoritmin perheeseen, joka muuntaa heikot oppijat (perusopiskelijat) vahvoiksi oppijoiksi. Heikko oppija on luokittelijat, jotka ovat oikein vain vähäisessä määrin todellisen luokituksen kanssa, kun taas vahvat oppijat ovat luokittelijoita, jotka korreloivat hyvin todellisen luokituksen kanssa. Harvat kuuluisat tehostamistekniikat ovat AdaBoost, GRADIENT BOOSTING, XgBOOST (Extreme Gradient Boosting). Joten nyt tiedämme, mitä pakkaaminen ja lisääminen ovat ja mitkä ovat heidän roolinsa koneoppimisessa.

Laukkujen ja korotusten tekeminen

Nyt ymmärretään, miten pakkaaminen ja lisääminen toimii:

pussitus

Baggingin toiminnan ymmärtämiseksi oletetaan, että meillä on N mallia ja tietojoukko D. Missä m on tietojen lukumäärä ja n on ominaisuuksien lukumäärä kussakin tiedossa. Ja meidän on tarkoitus tehdä binaariluokittelu. Ensin jaamme tietojoukon. Toistaiseksi jaamme tämän tietojoukon vain harjoitus- ja testijoukkoihin. Kutsutaan harjoitustietojoukkoksi missä on koulutusesimerkkien kokonaismäärä.

Ota näyte koulutusjoukon tietueista ja käytä sitä ensimmäisen mallin, esimerkiksi m1, kouluttamiseen. Seuraavaa mallia varten m2 on esimerkki harjoitusjoukosta ja ota uusi näyte harjoitussarjasta. Teemme saman asian N-mallien kohdalla. Koska otamme uudelleen harjoitustietoaineistoa ja otamme siitä näytteitä poistamatta mitään aineistosta, voi olla mahdollista, että meillä on kaksi tai useampia harjoitustietorekisteriä, jotka ovat yhteisiä useissa näytteissä. Tätä harjoitustietoaineiston uudelleennäyttelytapaa ja näytteen toimittamista mallille kutsutaan rivinäytteeksi korvaamisella. Oletetaan, että olemme kouluttaneet jokaisen mallin ja haluamme nyt nähdä ennusteen testitiedoissa. Koska työskentelemme binaariluokituksen tuloksena, voi olla joko 0 tai 1. Testitiedot välitetään jokaiselle mallille ja saamme ennusteen jokaisesta mallista. Oletetaan, että N-mallista enemmän kuin N / 2-malli ennusti sen olevan 1, joten käyttämällä mallin keskiarvotekniikkaa, kuten maksimiarvo, voimme sanoa, että testitietojen ennustettu lähtö on 1.

tehostaminen

Vahvistaessa otamme tietueet aineistosta ja välitämme ne perustason oppijoille peräkkäin, tässä tapauksessa perusopiskelijat voivat olla mitä tahansa malleja. Oletetaan, että meillä on m määrä tietueita tietojoukossa. Sitten välitämme muutama tietue oppijan BL1 perustamiseksi ja kouluttamiseksi. Kun BL1 on koulutettu, lähetämme kaikki tietueet aineistosta ja katsomme, kuinka perusopiskelija toimii. Kaikista tietueista, jotka perusopiskelija on luokitellut väärin, otamme ne vain ja siirrämme toiselle perusopiskelijalle, sanotaan BL2, ja samanaikaisesti lähetämme BL2: n luokittelemia vääriä tietueita kouluttaakseen BL3: n. Tämä jatkuu, jollei ja kunnes määrittelemme tietyn määrän tarvittavia perusopiskelijamalleja. Lopuksi yhdistämme näiden perusopiskelijoiden tuotokset ja saamme vahvan oppijan, minkä seurauksena mallin ennusteteho paranee. Ok. Joten nyt tiedämme, kuinka pakkaus ja lisäys toimivat.

Pakkaamisen ja lisäämisen edut ja haitat

Alla esitetään tärkeimmät edut ja haitat.

Pakkaamisen edut

- Pakkauksen suurin etu on, että useat heikot oppijat voivat toimia paremmin kuin yksi vahva oppija.

- Se tarjoaa stabiilisuuden ja lisää statistiikkaan luokittelussa ja regressiossa käytetyn koneoppimisalgoritmin tarkkuutta.

- Se auttaa vähentämään varianssia eli välttää liiallista asennusta.

Pakkaamisen haitat

- Se voi johtaa suureen esijännitykseen, jos sitä ei mallineta oikein, ja siten seurauksena voi olla vajaakuntoisuus.

- Koska meidän on käytettävä useita malleja, siitä tulee laskennallisesti kallista eikä se välttämättä sovellu useisiin käyttötapoihin.

Tehostuksen edut

- Se on yksi menestyneimmistä tekniikoista kahden luokan luokitteluongelmien ratkaisemisessa.

- Puuttuvien tietojen käsittely on hyvä.

Tehostamisen haitat

- Tehostamista on vaikea toteuttaa reaaliajassa algoritmin lisääntyneen monimutkaisuuden vuoksi.

- Tämän tekniikan suuri joustavuus johtaa moniin lukuihin parametreja, kuin joilla on suora vaikutus mallin käyttäytymiseen.

johtopäätös

Tärkein takea on, että pussittaminen ja nostaminen ovat koneoppimismalleja, joissa käytämme useita malleja saman ongelman ratkaisemiseksi ja paremman suorituskyvyn saavuttamiseksi. Ja jos yhdistämme heikot oppijat oikein, voimme saada vakaan, tarkan ja vankan mallin. Tässä artikkelissa olen antanut peruskatsauksen pakkaamisesta ja lisäämisestä. Tulevissa artikkeleissa opit tuntemaan molemmissa käytetyt tekniikat. Lopuksi lopuksi muistutan teille, että pussittaminen ja nostaminen ovat eniten käytettyjä tekniikoita yhtyeoppimisessa. Suorituskyvyn parantamisen todellinen taito on ymmärryksessäsi, milloin mallia käytetään ja kuinka virittää hyperparametrit.

Suositellut artikkelit

Tämä on opas pakkaamiseen ja lisäämiseen. Tässä keskustellaan johdannosta pakkaamiseen ja lisäämiseen ja sen työskentelemiseen sekä etuihin ja haitoihin. Voit myös käydä läpi muiden ehdotettujen artikkeleidemme saadaksesi lisätietoja -

- Johdatus yhtyetekniikoihin

- Koneoppimisen algoritmien luokat

- Gradientin korotusalgoritmi näytekoodilla

- Mikä on tehostamisalgoritmi?

- Kuinka luoda päätöksentekopuu?