Johdanto luokittelualgoritmeihin

Tämä luokittelualgoritmeja käsittelevä artikkeli antaa yleiskatsauksen erilaisista luokittelumenetelmistä, joita yleisesti käytetään tiedon louhintatekniikoissa, joilla on erilaiset periaatteet. Luokittelu on tekniikka, joka luokittelee tiedot erilliseen lukumäärään luokkia ja vuorostaan merkinnät osoitetaan jokaiselle luokalle. Luokituksen päätavoite on tunnistaa luokka uuden tiedon käynnistämiseksi analysoimalla koulutusjoukkoa näkemällä oikeat rajat. Kohderyhmän ja yllä olevan prosessin ennustamista kutsutaan yleisesti luokitukseksi.

Esimerkiksi sairaalan johto tallentaa potilaan nimen, osoitteen, iän, potilaan aiemman terveydentilan diagnoosin tekemiseen, mikä auttaa potilaiden luokittelua. Ne voidaan jakaa kahteen vaiheeseen: oppimisvaiheeseen ja arviointivaiheeseen. Oppimisvaihe mallii lähestymistavan perustaksi koulutustiedot, kun taas arviointivaihe ennustaa annetun tiedon tuotoksen. Löysimme heidän sovelluksiaan sähköpostin roskapostista, pankkilainan ennakoinnista, puheentunnistuksesta, Sentiment-analyysistä. Tekniikka sisältää matemaattisen funktion f tulolla X ja ulostulon Y.

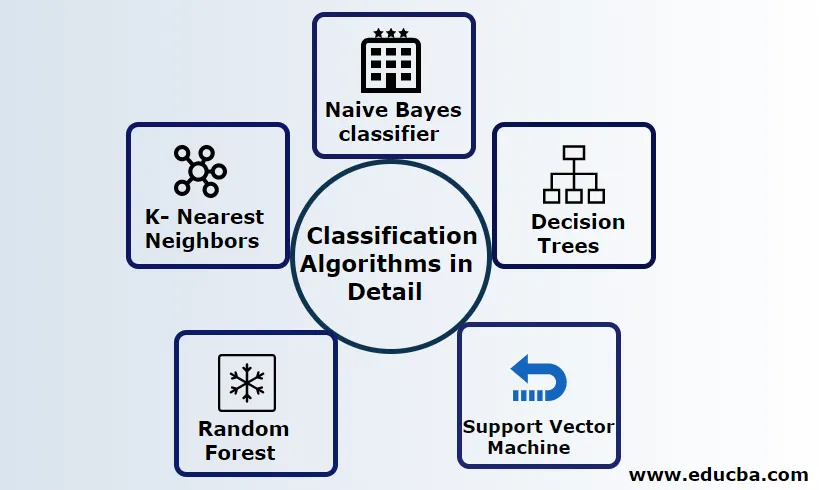

Selitä luokitusalgoritmit yksityiskohtaisesti

Luokittelu voidaan suorittaa sekä jäsennellylle että jäsentelemättömälle tiedolle. Luokittelu voidaan luokitella

- Naiivi Bayes -luokittelija

- Päätöspuut

- Tuki Vector Machine

- Satunnainen metsä

- K- Lähin naapurit

1) Naiivi Bayes -luokittelija

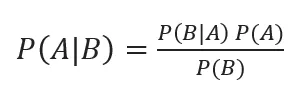

Se on Bayesin teoreemipohjainen algoritmi, yksi tilastollisista luokituksista ja vaatii muutamia määriä harjoitustietoja parametrien, joita kutsutaan myös todennäköisyysluokkijoiksi, arvioimiseksi. Sitä pidetään nopeimpana luokittelijana, erittäin skaalautuva ja käsittelee sekä erillistä että jatkuvaa tietoa. Tätä algoritmia käytettiin ennustamiseen reaaliajassa. On olemassa erityyppisiä naiiveja, Multinomial Naive Bayes, Bernoulli Naive Bayes, Gaussian naiveja.

Bayesin luokittelu takaosan todennäköisyyksillä annetaan

Missä A, B ovat tapahtumia, P (A | B) - takaosan todennäköisyydet.

Jos kaksi arvoa ovat toisistaan riippumattomia,

P (A, B) = P (A) P (B)

Naiivi Bayes voidaan rakentaa python-kirjaston avulla. Naivin ennustajat ovat riippumattomia, tosin niitä käytetään suositusjärjestelmissä. Niitä käytetään monissa reaaliaikaisissa sovelluksissa ja niitä käytetään tietoisesti asiakirjojen luokittelussa.

edut:

Etuna on se, että ne vaativat hyvin vähemmän laskentatehoa, oletetaan usean luokan ennusteongelmissa, toimivat tarkasti suurissa tietojoukkoissa.

haitta:

Tämän luokittelijan päähaitta on, että ne antavat nolla todennäköisyyden. Ja heillä on ominaisuuksia, jotka ovat toisistaan riippumattomia.

2) Päätöspuu

Se on ylhäältä alas suuntautuva lähestymistapa, jossa vuokaavion rakenne käsittelee korkeaulotteista tietoa. Tulokset ennustetaan annetun syötemuuttujan perusteella. Päätöspuu, joka koostuu seuraavista elementeistä: Juuri, monet solmut, oksat, lehdet. Juurisolmu suorittaa osion luokan ominaisuusarvon perusteella, sisäinen solmu ottaa määritteen lisäluokittelua varten, haarat tekevät päätöksensäännön jakaa solmut lehtisolmuiksi, ja lopuksi lehden solmut antavat lopullisen lopputuloksen. Päätöksen puun aikakompleksiisuus riippuu tietueiden lukumäärästä, harjoitustietojen määristä. Jos päätöksentekopuu on liian pitkä, on vaikeaa saada haluttuja tuloksia.

Etu: Niitä käytetään ennustavaan analytiikkaan ongelmien ratkaisemiseksi, ja niitä käytetään päivittäisissä toimissa tavoitteen valintaan päätöksenanalyysin perusteella. Rakentaa mallin automaattisesti lähdetietoihin perustuen. Paras puuttuvien arvojen käsittely.

Haitta: Puun koko on hallitsematon, kunnes sillä on joitain pysäytyskriteerejä. Heidän hierarkkisen rakenteensa vuoksi puu on epävakaa.

3) Tuki Vector Machine

Tällä algoritmilla on tärkeä rooli luokitteluongelmissa ja suosituimmin koneoppimisohjatut algoritmit. Se on tärkeä työkalu, jota tutkija ja tietotekijä käyttävät. Tämä SVM on erittäin helppo ja sen prosessi on löytää hypertaso N-ulotteisista avaruusdatapisteistä. Hyperlennot ovat päätöksenrajoja, jotka luokittelevat datapisteet. Kaikki tämä vektori putoaa lähemmäksi hyperkorttia, maksimoi luokittelijan marginaali. Jos marginaali on suurin, pienin on yleistämisvirhe. Niiden toteutus voidaan suorittaa ytimellä pythonilla joidenkin harjoitustietojen kanssa. SVM: n päätavoite on kouluttaa kohde tiettyyn luokitukseen. SVM: llä ei ole rajoitettua tulla lineaariseksi luokittelijaksi. SVM on parempi kuin mikä tahansa luokittelumalli niiden ytimen toiminnan vuoksi, joka parantaa laskentatehokkuutta.

Etu: Ne ovat erittäin edullisia sen pienemmän laskentatehon ja tehokkaan tarkkuuden vuoksi. Tehokas korkeaulotteisessa tilassa, hyvä muistin hyötysuhde.

Haitta: nopeuden, ytimen ja koon rajoitukset

4) Satunnainen metsä

Se on tehokas koneoppimisalgoritmi, joka perustuu Ensemblen oppimislähestymistapaan. Satunnaisen metsän peruskivi on päätöksentekopuu, jota käytetään ennustavien mallien rakentamiseen. Työdemonstraatioon sisältyy satunnaisten päätöspuiden metsän luominen ja karsintaprosessi suoritetaan asettamalla pysäytyshalkaisut paremman tuloksen aikaansaamiseksi. Satunnainen metsä toteutetaan käyttämällä tekniikkaa, jota kutsutaan pussittamiseksi päätöksentekoon. Tämä pussitus estää datan liiallisen asettamisen vähentämällä esijännitystä samalla tavalla tämä satunnaisuus voi saavuttaa paremman tarkkuuden. Lopullisen ennusteen tekee keskimäärin useita päätöksentekopuita, toisin sanoen usein ennusteita. Satunnainen metsä sisältää monia käyttötapauksia, kuten osakemarkkinoiden ennusteet, petosten havaitseminen, uutiset.

edut:

- Ei vaadi suurta käsittelyä tietoaineistojen käsittelemiseksi ja erittäin helppoa mallia rakentaa. Tarjoaa paremman tarkkuuden ennakoivien ongelmien ratkaisemisessa.

- Toimii hyvin puuttuvien arvojen käsittelyssä ja havaitsee poikkeavuuden automaattisesti.

haitta:

- Edellyttää korkeita laskennallisia kustannuksia ja suurta muistia.

- Vaatii paljon enemmän ajanjaksoa.

5) K- Lähin naapuri

Tässä keskustellaan K-NN-algoritmista ohjatun CART-oppimisen kanssa. He käyttävät K-positiivista pientä kokonaislukua; objekti luokkaan osoitetaan naapureiden perusteella tai sanomme ryhmän nimeämisen tarkkailemalla missä ryhmässä naapuri valehtelee. Tämä valitaan etäisyyden mitattuna Euklidisen etäisyyden ja raa'an voiman avulla. K: n arvo löytyy viritysprosessista. KNN ei halua oppia mitään malleja uuden tietojoukon kouluttamiseksi ja normalisoinnin avulla datan skaalaamiseen.

Etu: Tuottaa tehokkaita tuloksia, jos harjoitustiedot ovat valtavia.

Haitta: Suurin ongelma on, että jos muuttuja on pieni, se toimii hyvin. Toiseksi valitaan K-tekijä luokitellessaan.

johtopäätös

Yhteenvetona voidaan todeta, että olemme käyneet läpi erilaisten luokittelualgoritmien kyvyt edelleen tehokkaana työkaluna ominaisuuksien suunnittelussa, kuvan luokittelussa, joka on hieno resurssi koneoppimiseen. Luokittelualgoritmit ovat tehokkaita algoritmeja, jotka ratkaisevat kovat ongelmat.

Suositellut artikkelit

Tämä on opas luokittelualgoritmeihin koneoppimisessa. Tässä keskustellaan siitä, että luokittelu voidaan suorittaa sekä jäsennellylle että jäsentelemättömälle tiedolle. Voit myös käydä läpi muiden ehdottamiemme artikkeleidemme -

- Reititysalgoritmit

- Rypytysalgoritmi

- Tietojen louhintaprosessi

- Koneoppimisen algoritmit

- Ensemble-oppimisen eniten käytettyjä tekniikoita

- C ++ -algoritmi | Esimerkkejä C ++ -algoritmista